天文攝影的感光元件 (2) : 拍攝彩色影像

最後編輯時間: 西曆2023年05月22日

oldmiow

天文攝影單元式入門教學系列

天文攝影的感光元件 (2) :

拍攝彩色影像

在接收到望遠鏡或鏡頭成像而來的光時,感光元件上的像素,其半導體結構中的電子,可以因吸收光子而激發,這些激發的電子接着被蒐集起來,蒐集了越多電子,便表示該像素所記錄的區域,其成像越亮。

§拍攝彩色影像

人類的視覺屬於三色視覺,意即有藍、綠、紅三色,人眼透過感測三色的多寡,判斷出顏色。因此一般我們所認知的照片,也得能反映多種顏色,而這顏色,便是由藍、綠、紅三色以不同比例組成。

不同顏色的光,實際上是不同波長的光,意即其光子有着不同的能量,比如紅光的單個光子能量較低,藍光則較高。只要光子能夠進入像素,並且激發電子,就能產生信號,但像素本身無法分辨產生電子的光子,到底是來自紅光,還是藍光,抑或是其他顏色的光,因此像素本身只能記錄亮暗,無法記錄顏色。

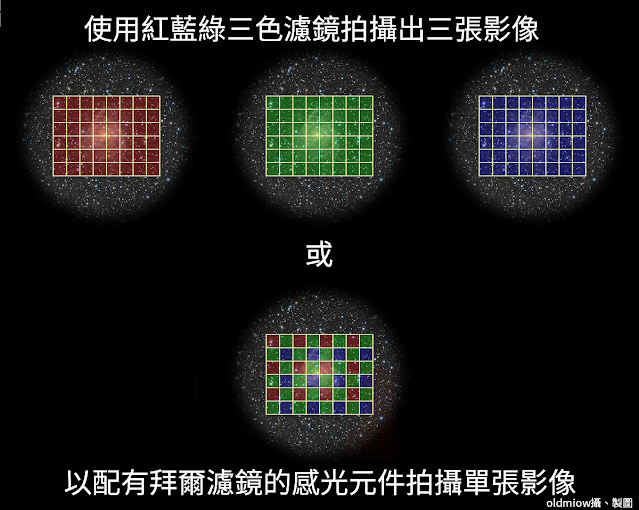

要得到彩色影像,有兩大類做法,如下方 (圖一) 上部所示,第一類做法是在感光元件前方加上濾鏡,見 (圖二) ,比如以藍、綠、紅三色濾鏡分別拍攝,得到三張影像,接着再把三張影像合成在一起。由於大多數遙遠的天體,在短時間內沒有明顯可見的變化,因此這種拍攝方式,在天文攝影中尚能應用。但在日常生活中,這種方式難以應用,因爲該做法必須得拍攝三次,不光操作繁瑣,且拍攝物很可能在拍攝過程中變化,手持相機也無法穩定到三次都對到同樣的方位。

|

| 圖一,兩種拍攝紅藍綠三色影像的方法 |

|

| 圖二,過濾不同顏色的濾鏡 |

因此,在 (圖一) 下部所展示的第二種做法,是在每一個微小的像素上都覆蓋濾色層 (濾鏡),使單一一次拍攝,就可以得到包含三種顏色資料的影像,只不過,一個像素只包含一種顏色,所以最後必須從旁邊的像素,以插值,大概地「估算」出某像素的其他兩種顏色,再合成得到彩色影像。這種做法也就是日常生活中,手機、數位相機、視訊攝像頭等等消費產品,所採用的做法,但由於該做法使用插值估計,而不是真正地拍攝下某像素位置的三種顏色,所以無法滿足諸如天文觀測等,需要準確測定像素亮度的應用。

(圖一) 下部展示的拜爾濾鏡 (Bayer filter) ,是柯達公司的工程師布萊斯·愛德華·拜爾 (Bryce Edward Bayer) ,在1970年代所發明,感光元件上的像素以四個爲一組,一個接收紅色光,兩個接收綠色光,一個接收藍色光,其中接收綠色光的像素較多,是爲了模仿人眼對綠光更敏感。

下方 (圖三) 是一個實際的感光元件,在顯微鏡下的景象,左側黃框中的是一片感光元件晶片的角落,晶片上除了實際的電子線路跟微元件,有時還會製有文字等資訊,在晶片的右下方有着大量的像素。若放大 (圖三) 紅色虛線框中的區域,便是右側紅框中的景象,可見一顆一顆藍、綠、紅色的顆粒,這些便是拜爾濾鏡,右下角較暗區域的像素,才是真正感光區域的像素,但由於太暗了,故其上附着的拜爾濾鏡並不明顯。 (圖四) 是另外一個感光元件像素的顯微影像,這也是靠近晶片邊緣區域的影像,明顯可見感光像素上的拜爾濾鏡。

|

| 圖三,顯微鏡下的感光元件 MN39483 |

|

| 圖四,顯微鏡下的感光元件 OV508AC |

下方 (圖五) 的左側黃框中,是一張風景照,是由一般的數位相機拍攝得到,而將其中紅色虛線框中的影像放大,便是右上角紅框中的影像,但這些並不是原始的影像,而是經過插值計算並合成出的結果。右下角綠色框中所示的,才是右上角紅色框影像的原始樣貌,相機感光元件所輸出的,便是這樣的影像,由於這種原始影像有如馬賽克般的型態,故將馬賽克影像,經由插值計算,合成爲彩色影像的做法,也稱爲「去馬賽克」(Demosaicing)。

|

| 圖五,一張風景照和其局部,以及局部影像所對應的原始影像 |

(圖五) 右下綠色框中的背景的天空區域,很明顯可見有的像素較暗,有的像素較亮,這便是拜爾濾鏡的效果,較暗的是接收紅光的像素,而較亮的則是接收綠光的像素,或者接收藍光的像素。天空區域的藍光像素或者綠光像素亮度接近,所以不好分辨哪個是綠,哪個是藍,下方樹葉部分就可以明顯分辨了,左上角的暗像素爲紅色像素,右下角的暗像素爲藍色像素,左下和右上較亮的像素則是綠色像素。下方 (圖六) 是 (圖五) 右下角綠色框中的影像內,天空與樹葉的交界區域,上方爲天空,下方爲樹葉,像素所對應的不同顏色拜爾濾鏡標示於其上。

|

| 圖六, (圖五) 右下綠色框中的影像內,天空與樹葉的交界區域 |

§更廣義的色彩

若感光元件的像素前,設有拜爾濾鏡之類的濾色層,則使用該種感光元件的相機,就稱爲彩色相機 (Color Camera),反之,若相機使用沒有濾色層覆蓋的感光元件,則稱爲單色相機 (Monochrome Camera),有時也稱爲黑白相機。

使用單色相機最大的優勢,是其可以自由地搭配濾鏡,並不侷限於藍、綠、紅三色濾鏡,三色濾鏡的透過波段與帶寬 (透過波段的寬度) 大概是

藍色濾鏡: 400nm至500nm,帶寬100nm

綠色濾鏡: 500nm至600nm,帶寬100nm

紅色濾鏡: 600nm至700nm,帶寬100nm

在天文攝影中,有一些天體會發出特定波長的光,比如「Hα」(氫),波長大概爲656.28nm,是紅色發射星雲主要發出的光,因此有專門過濾這種光的窄帶 (窄頻) 濾鏡,這種濾鏡的透過波段設計得很窄,僅有數個納米 (nm)。

單色相機使用諸如 Hα 濾鏡這類的窄帶濾鏡,則所有的像素都可以接收光子,但倘若,使用的是採用拜爾濾鏡感光元件的彩色相機,那僅有紅色像素可以接收光子,因爲 Hα 濾鏡過濾出波長大致爲656.28nm的紅光,幾乎無法穿透像素前拜爾濾鏡的綠色和藍色濾鏡,意即整個感光元件,只有佔比 1 / 4 的紅色像素可以接收光子,剰下 3 / 4 的藍或綠色像素都浪費了。

在可見光之中,星雲發出的特定波長光,除了波長約656.28nm的 Hα,其餘比較顯著的,還有波長約672nm的 [S II] (硫),以及波長約500nm的 [O III] (氧)。其中 [O III] 介於藍光和綠光之間,但 Hα 和 [S II] 都是紅光,難以分辨。而若使用窄帶濾鏡拍攝,再人爲地將 [S II] 當作紅色,Hα 當作綠色, [O III] 當作藍色,並加以合成,就能透過影像的顏色分佈,直觀地觀察出硫元素和氫元素,在星雲中的分布情形。

感光元件的感光範圍,也不局限於可見光,一般常見的矽 (硅) 基半導體感光元件,可以接收一部份近紅外線和近紫外線,而一些不同材料製成的感光元件乃至其他儀器,還可以接收如 γ (gamma) 射線、 X 光、紫外線、紅外線、無線電,乃至微波,這些不同儀器採集到的不同信號,其組成的影像,也都可以人爲地定義顏色並加以合成,一些科學機構所提供的亮麗天體影像,許多便是以這些未必是可見光的影像加以合成而得,比如紫外線當紅色,X光當藍色,而無線電當綠色。

感謝您分享這文章,受益良多

回覆刪除